Vn-Z.vn ngày 29 tháng 03 năm 2023, Trong thông báo chính thức từ OpenAI, trước sự háo hức của thế giới và sự thành công của mô hình GPT-4 . OpenAI dự kiến sẽ phát phát hành phiên bản tiếp theo GPT-5 vào cuối năm 2023.

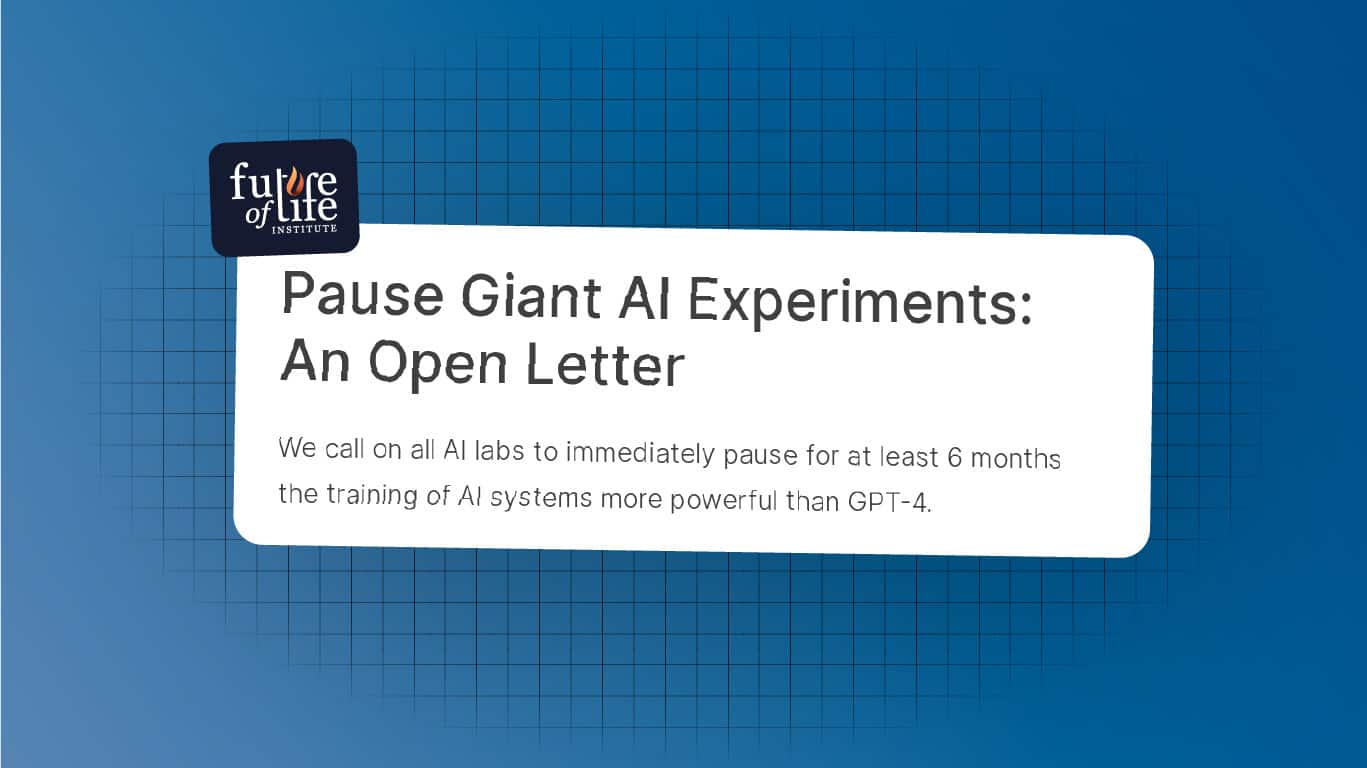

Mô hình GPT -5 được xây dựng dựa trên nền tảng của GPT-4, phiên bản mới dự kiến sẽ mang đến hàng loạt tính năng thú vị và khả năng nâng cao. Tuy nhiên, hiện tại GPT-4 mạnh đến mức không chỉ quần chúng hoang mang mà ngày cả các nhà lãnh đạo AI trên toàn thế giới cũng cảm thấy cần phải hành động! Hàng nghìn người đã cùng tham gia một bức thư chung của tổ chức futureoflife kêu gọi mọi người tạm dừng đào tạo AI mạnh hơn GPT-4.

Trong bức thư trên futureoflife đã thu hút được hơn 1.000 chuyên gia và các ông lớn công nghệ, kêu gọi ngừng ngay việc đào tạo các hệ thống AI mạnh hơn GPT-4, ít nhất là 6 tháng.

Trong danh sách có thể thấy các nhân vật nổi tiếng như giáo sư Yoshua Bengio ( nhà khoa học máy tính người Canada, được chú ý nhiều nhất với công trình nghiên cứu về mạng thần kinh nhân tạo và học sâu), Emad Mostaque sáng lập và Giám đốc điều hành của Stability AI, Steve Wozniak đồng sáng lập Apple , Marcus giáo sư Đại học New York , Elon Musk CEO SpaceX, Tesla & Twitter .v.v.v.

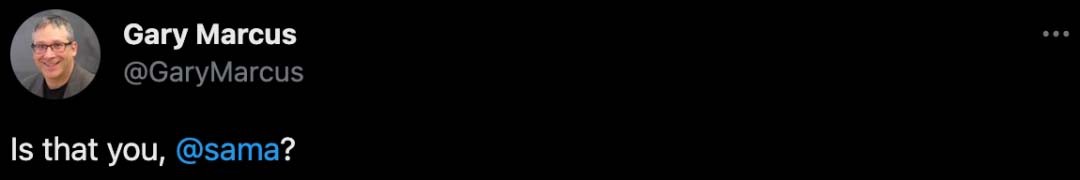

Tuy nhiên không rõ liệu hành động thu thập chữ ký của tổ chức futureoflife này có khiến GTP -5 tạm dùng phát hành hay không. Nhưng quan sát chúng ta có thể thấy một chữ ký rất lạ đến từ Sam Altman Giám đốc điều hành của OpenAI . Hành động này rất khó hiểu, khiến Marcus phải xác nhận lại có đúng không ? Hiện tại chữ ký của vị CEO OpenAI đã biến mất ?

Theo nội dung được chia sẻ từ bức thư của futureoflife, có một số lượng lớn các nghiên cứu đã chỉ ra rằng các hệ thống AI với trí thông minh nhân tạo cạnh tranh của con người được các phòng thí nghiệm AI hàng đầu công nhận có thể gây ra rủi ro sâu sắc cho xã hội và con người.

Tạm dịch một số đoạn

Như đã nêu trong Nguyên tắc AI của Asilomar được công nhận rộng rãi, AI tiên tiến có thể đồng nghĩa với những thay đổi sâu sắc trong lịch sử sự sống trên Trái đất và cần được lên kế hoạch quản lý với sự cân nhắc và nguồn lực phù hợp.

Tuy nhiên trong thời gian gần đây , các phòng thí nghiệm, nghiên cứu AI trên toàn thế giới đang điên cuồng khởi động những cuộc đua AI nhằm phát triển và triển khai những AI mạnh mẽ hơn, điều mà không ai có thể hiểu, dự đoán, kiểm soát những AI này, kể cả người tạo ra chúng.

Không có nhà lãnh đạo công nghệ không được lựa chọn nào có thẩm quyền đưa ra quyết định ở mức độ này.

Chỉ khi chúng ta tin tưởng rằng tác động của AI như vậy là tích cực và những rủi ro có thể kiểm soát được thì chúng ta mới nên phát triển các hệ thống AI mạnh mẽ. Và chúng ta phải có lý do chính đáng để tin vào điều đó, tác động tiềm năng càng lớn thì chúng ta càng cần phải tin vào điều đó.

Tuyên bố gần đây của OpenAI về trí tuệ nhân tạo nói chung cho biết "ở một số giai đoạn, đánh giá độc lập có thể quan trọng trước khi bắt đầu đào tạo các hệ thống trong tương lai và cần có giới hạn về tốc độ mà sức mạnh tính toán được sử dụng để tạo các mô hình mới có thể phát triển."

Chúng tôi đồng ý với điều đó, và thời điểm đó là bây giờ. Do đó, chúng tôi kêu gọi tất cả các phòng thí nghiệm AI ngay lập tức tạm dừng đào tạo các hệ thống AI mạnh hơn GPT-4 trong ít nhất 6 tháng.

Hành động tạm dừng này phải được mở cho tất cả mọi người, có thể kiểm chứng bởi tất cả mọi người và có sự tham gia của tất cả các thành viên chủ chốt. Nếu không có lệnh cấm nhanh chóng, chính phủ nên can thiệp.

Trong khoảng thời gian 6 tháng, tất cả các phòng thí nghiệm AI và các học giả độc lập nên hợp tác để phát triển một bộ giao thức bảo mật dùng chung cho việc thiết kế và phát triển AI tiên tiến. Sau khi thỏa thuận được hoàn thành, nó cần được kiểm tra và giám sát chặt chẽ bởi các chuyên gia độc lập bên ngoài. Các giao thức này phải đảm bảo sự an toàn không thể nghi ngờ của các hệ thống AI .

Điều này không có nghĩa là chúng ta nên tạm dừng hoàn toàn việc phát triển AI, mà chỉ là chúng ta nên lùi một bước khỏi cuộc đua nguy hiểm để hướng tới các mô hình mới nổi, lớn hơn và không thể đoán trước.

Tất cả các nghiên cứu và phát triển AI nên được tập trung lại vào điểm này , làm cho các mô hình SOTA mạnh mẽ nhất hiện nay trở nên chính xác hơn, an toàn, có thể giải thích được, minh bạch, mạnh mẽ, phù hợp, đáng tin cậy và trung thành với con người.

Đồng thời, các nhà phát triển phải làm việc với các nhà hoạch định chính sách để tăng tốc đáng kể sự phát triển của các hệ thống quản lý AI mạnh mẽ.

Hệ thống quản lý AI này ít nhất phải bao gồm:

- Một cơ quan dành riêng cho việc điều chỉnh AI

- Hệ thống nguồn gốc và thủy ấn để giúp phân biệt nội dung thực với nội dung được tạo và cho phép theo dõi rò rỉ mô hình

- Hệ thống kiểm toán và chứng nhận mạnh mẽ

-Làm rõ ai chịu trách nhiệm khi AI gây hại

- Cung cấp tài trợ công mạnh mẽ cho nghiên cứu công nghệ an toàn AI

Nhân loại có thể tận hưởng một tương lai thịnh vượng do AI mang lại. Sau khi tạo thành công các hệ thống AI mạnh mẽ, chúng ta có thể tận hưởng "mùa hè của AI" và gặt hái những phần thưởng khi thiết kế các hệ thống nói trên để mang lại lợi ích cho tất cả mọi người và cho toàn nhân loại cơ hội thích nghi.

..

Ngay sau đó, bức thư ngỏ có chữ ký của hàng nghìn ông lớn trong làng công nghệ , những người ủng hộ bức thư cho rằng sự bất an và lo lắng về AI là hợp lý, bởi vì hiệu quả đào tạo của AI quá cao và mức độ thông minh đang ngày càng được nâng cấp.

Trong cuộc phỏng vấn được công bố ngày hôm qua của Sam Altman. Ông nói rằng các nhà nghiên cứu của OpenAI không thể tìm ra lý do tại sao GPT có khả năng suy luận. Họ chỉ biết rằng trong quá trình thử nghiệm liên tục, mọi người đột nhiên phát hiện ra rằng bắt đầu từ ChatGPT, GPT bắt đầu có khả năng suy luận. Ngoài ra, Altman cũng đã nói một câu gây sốc trong cuộc phỏng vấn: "AI thực sự có thể ảnh hưởng tới con người." ( ảnh hưởng đã tiết giảm)

Ngoài Altman, các chuyên gia công nghệ như Geoffrey Hinton, Bill Gates, giáo sư Gary Marcus của Đại học New York cũng đưa ra cảnh báo: Việc AI tớilàm ảnh hưởng con người thực sự không phải là lời nói suông.

vn-z.vn

vn-z.vn

Hiện tại GPT-4 đã có thể vượt qua các bài kiểm tra kỹ sư, thi đại học, .v.v. nhiều người lo ngại rằng trong vài năm tới AI có thể đạt được nhận thức ở cấp độ con người, chúng có thể nhận biết đâu là con người cũng như cách nhận biết với thế giới. AI vượt trội con người trong việc lên kế hoạch phức tạp và hiệu quả, làm tốt hơn hầu hết các công việc cơ bản , có thể lập trình, vượt trội hơn kỹ năng máy tính của một nhân viên văn phòng.v.v.v...

Tuy có nhiều lo ngại nhưng cư dân mạng rất háo hức mong đợi GPT -5. GPT-5 sẽ mang đến hàng loạt tính năng thú vị và hiệu suất nâng cao trên nền tảng của GPT-4, chẳng hạn như sự vượt trội toàn diện về độ tin cậy, khả năng sáng tạo và khả năng thích ứng với các tác vụ phức tạp.

Còn bạn ! Bạn nghĩ sao về GPT ? Liệu GPT -5 có bị tạm dừng ? Hãy chia sẻ cảm nghĩ của mình !

futureoflife.org

futureoflife.org

Trong bức thư trên futureoflife đã thu hút được hơn 1.000 chuyên gia và các ông lớn công nghệ, kêu gọi ngừng ngay việc đào tạo các hệ thống AI mạnh hơn GPT-4, ít nhất là 6 tháng.

Trong danh sách có thể thấy các nhân vật nổi tiếng như giáo sư Yoshua Bengio ( nhà khoa học máy tính người Canada, được chú ý nhiều nhất với công trình nghiên cứu về mạng thần kinh nhân tạo và học sâu), Emad Mostaque sáng lập và Giám đốc điều hành của Stability AI, Steve Wozniak đồng sáng lập Apple , Marcus giáo sư Đại học New York , Elon Musk CEO SpaceX, Tesla & Twitter .v.v.v.

Tuy nhiên không rõ liệu hành động thu thập chữ ký của tổ chức futureoflife này có khiến GTP -5 tạm dùng phát hành hay không. Nhưng quan sát chúng ta có thể thấy một chữ ký rất lạ đến từ Sam Altman Giám đốc điều hành của OpenAI . Hành động này rất khó hiểu, khiến Marcus phải xác nhận lại có đúng không ? Hiện tại chữ ký của vị CEO OpenAI đã biến mất ?

Theo nội dung được chia sẻ từ bức thư của futureoflife, có một số lượng lớn các nghiên cứu đã chỉ ra rằng các hệ thống AI với trí thông minh nhân tạo cạnh tranh của con người được các phòng thí nghiệm AI hàng đầu công nhận có thể gây ra rủi ro sâu sắc cho xã hội và con người.

Tạm dịch một số đoạn

Như đã nêu trong Nguyên tắc AI của Asilomar được công nhận rộng rãi, AI tiên tiến có thể đồng nghĩa với những thay đổi sâu sắc trong lịch sử sự sống trên Trái đất và cần được lên kế hoạch quản lý với sự cân nhắc và nguồn lực phù hợp.

Tuy nhiên trong thời gian gần đây , các phòng thí nghiệm, nghiên cứu AI trên toàn thế giới đang điên cuồng khởi động những cuộc đua AI nhằm phát triển và triển khai những AI mạnh mẽ hơn, điều mà không ai có thể hiểu, dự đoán, kiểm soát những AI này, kể cả người tạo ra chúng.

Không có nhà lãnh đạo công nghệ không được lựa chọn nào có thẩm quyền đưa ra quyết định ở mức độ này.

Chỉ khi chúng ta tin tưởng rằng tác động của AI như vậy là tích cực và những rủi ro có thể kiểm soát được thì chúng ta mới nên phát triển các hệ thống AI mạnh mẽ. Và chúng ta phải có lý do chính đáng để tin vào điều đó, tác động tiềm năng càng lớn thì chúng ta càng cần phải tin vào điều đó.

Tuyên bố gần đây của OpenAI về trí tuệ nhân tạo nói chung cho biết "ở một số giai đoạn, đánh giá độc lập có thể quan trọng trước khi bắt đầu đào tạo các hệ thống trong tương lai và cần có giới hạn về tốc độ mà sức mạnh tính toán được sử dụng để tạo các mô hình mới có thể phát triển."

Chúng tôi đồng ý với điều đó, và thời điểm đó là bây giờ. Do đó, chúng tôi kêu gọi tất cả các phòng thí nghiệm AI ngay lập tức tạm dừng đào tạo các hệ thống AI mạnh hơn GPT-4 trong ít nhất 6 tháng.

Hành động tạm dừng này phải được mở cho tất cả mọi người, có thể kiểm chứng bởi tất cả mọi người và có sự tham gia của tất cả các thành viên chủ chốt. Nếu không có lệnh cấm nhanh chóng, chính phủ nên can thiệp.

Trong khoảng thời gian 6 tháng, tất cả các phòng thí nghiệm AI và các học giả độc lập nên hợp tác để phát triển một bộ giao thức bảo mật dùng chung cho việc thiết kế và phát triển AI tiên tiến. Sau khi thỏa thuận được hoàn thành, nó cần được kiểm tra và giám sát chặt chẽ bởi các chuyên gia độc lập bên ngoài. Các giao thức này phải đảm bảo sự an toàn không thể nghi ngờ của các hệ thống AI .

Điều này không có nghĩa là chúng ta nên tạm dừng hoàn toàn việc phát triển AI, mà chỉ là chúng ta nên lùi một bước khỏi cuộc đua nguy hiểm để hướng tới các mô hình mới nổi, lớn hơn và không thể đoán trước.

Tất cả các nghiên cứu và phát triển AI nên được tập trung lại vào điểm này , làm cho các mô hình SOTA mạnh mẽ nhất hiện nay trở nên chính xác hơn, an toàn, có thể giải thích được, minh bạch, mạnh mẽ, phù hợp, đáng tin cậy và trung thành với con người.

Đồng thời, các nhà phát triển phải làm việc với các nhà hoạch định chính sách để tăng tốc đáng kể sự phát triển của các hệ thống quản lý AI mạnh mẽ.

Hệ thống quản lý AI này ít nhất phải bao gồm:

- Một cơ quan dành riêng cho việc điều chỉnh AI

- Hệ thống nguồn gốc và thủy ấn để giúp phân biệt nội dung thực với nội dung được tạo và cho phép theo dõi rò rỉ mô hình

- Hệ thống kiểm toán và chứng nhận mạnh mẽ

-Làm rõ ai chịu trách nhiệm khi AI gây hại

- Cung cấp tài trợ công mạnh mẽ cho nghiên cứu công nghệ an toàn AI

Nhân loại có thể tận hưởng một tương lai thịnh vượng do AI mang lại. Sau khi tạo thành công các hệ thống AI mạnh mẽ, chúng ta có thể tận hưởng "mùa hè của AI" và gặt hái những phần thưởng khi thiết kế các hệ thống nói trên để mang lại lợi ích cho tất cả mọi người và cho toàn nhân loại cơ hội thích nghi.

..

Ngay sau đó, bức thư ngỏ có chữ ký của hàng nghìn ông lớn trong làng công nghệ , những người ủng hộ bức thư cho rằng sự bất an và lo lắng về AI là hợp lý, bởi vì hiệu quả đào tạo của AI quá cao và mức độ thông minh đang ngày càng được nâng cấp.

Trong cuộc phỏng vấn được công bố ngày hôm qua của Sam Altman. Ông nói rằng các nhà nghiên cứu của OpenAI không thể tìm ra lý do tại sao GPT có khả năng suy luận. Họ chỉ biết rằng trong quá trình thử nghiệm liên tục, mọi người đột nhiên phát hiện ra rằng bắt đầu từ ChatGPT, GPT bắt đầu có khả năng suy luận. Ngoài ra, Altman cũng đã nói một câu gây sốc trong cuộc phỏng vấn: "AI thực sự có thể ảnh hưởng tới con người." ( ảnh hưởng đã tiết giảm)

Ngoài Altman, các chuyên gia công nghệ như Geoffrey Hinton, Bill Gates, giáo sư Gary Marcus của Đại học New York cũng đưa ra cảnh báo: Việc AI tớilàm ảnh hưởng con người thực sự không phải là lời nói suông.

ChatGPT vượt qua bài kiểm tra đầu vào kỹ sư cấp L3 của Google

Vn-Z.vn Ngày 06 tháng 02 năm 2023, CNBC cho biết theo thử nghiệm nội bộ của Google, ChatGPT có thể vượt qua cuộc phỏng vấn dành cho kỹ sư phần mềm cấp dưới của Google. Kkhi phỏng vấn cho các vị trí viết code, ChatGPT đã được tuyển dụng với vị trí kỹ sư L3. Được biết L3 là vị trí kỹ sư phần mềm...

Hiện tại GPT-4 đã có thể vượt qua các bài kiểm tra kỹ sư, thi đại học, .v.v. nhiều người lo ngại rằng trong vài năm tới AI có thể đạt được nhận thức ở cấp độ con người, chúng có thể nhận biết đâu là con người cũng như cách nhận biết với thế giới. AI vượt trội con người trong việc lên kế hoạch phức tạp và hiệu quả, làm tốt hơn hầu hết các công việc cơ bản , có thể lập trình, vượt trội hơn kỹ năng máy tính của một nhân viên văn phòng.v.v.v...

Tuy có nhiều lo ngại nhưng cư dân mạng rất háo hức mong đợi GPT -5. GPT-5 sẽ mang đến hàng loạt tính năng thú vị và hiệu suất nâng cao trên nền tảng của GPT-4, chẳng hạn như sự vượt trội toàn diện về độ tin cậy, khả năng sáng tạo và khả năng thích ứng với các tác vụ phức tạp.

Còn bạn ! Bạn nghĩ sao về GPT ? Liệu GPT -5 có bị tạm dừng ? Hãy chia sẻ cảm nghĩ của mình !

Pause Giant AI Experiments: An Open Letter - Future of Life Institute

We call on all AI labs to immediately pause for at least 6 months the training of AI systems more powerful than GPT-4.